Компанія, що спеціалізується на кібербезпеці, показала, що один лише невеликий малюнок на асфальті здатний обдурити автопілот Tesla і вивести машину на зустрічну смугу. Про це компанія повідомила в своєму звіті.

До цього представники Tesla оголосили, що готові подарувати Model 3 кожному, хто зламає комп’ютерну систему автомобіля. Група китайських хакерів з компанії Keen Security Lab зробила це двічі. У 2016 році вони віддалено зламали Model S через Wi-Fi. Схожу операцію вони проробили в 2017-м. Тепер фахівцям вдалося втретє обдурити програмне забезпечення машини, але вже без допомоги Wi-Fi.

Вони зосередилися на здатності автопілота розпізнавати дорожні смуги. За їх словами, в Tesla додали програмні можливості реєструвати «аномальні смуги», тобто ті, на яких частково стерлася розмітка. Ця ж особливість призвела до виникнення уразливості.

©Keen Security Lab

Спочатку співробітники компанії розмістили на основній лінії, що розділяє дві смуги, “спеціальні пластирі”, які розмивали малюнок. Автори звіту вважають, що таку технологію навряд чи будуть використовувати в реальності, але вони не могли відкидати саму можливість. Ця тактика не принесла результатів.

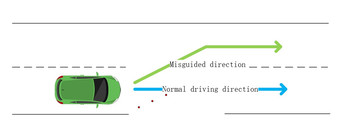

Потім хакери припустили інший сценарій. У ньому не спотворювалася вже чинна розмітка, але додавалася нова. Вони нанесли на асфальт три білих квадрати, які частково перекривали смугу і вели на зустрічну. Автомобіль розпізнав їх як продовження правої лінії і, ігноруючи ліву, виїхав на іншу смугу. У звіті написано: «Вводити в оману автопілот за допомогою нових елементів розмітки може бути більш небезпечно, ніж нездатність помітити лінію».

©Keen Security Lab

У компанії Ілона Маска на це відповіли наступне:

«У цій демонстрації дослідники змінили фізичне середовище навколо транспортного засобу, щоб змусити його поводитися інакше. Це не реальна проблема, не та, з якою стикаються кожен день, враховуючи і те, що водій може в будь-який час перейняти керування автомобілем і натиснути на гальма».

Відкриття Keen Security Lab не увійшло в програму винагороди Tesla.