Дослідники протестували алгоритми проти ботів, які використовують на різних платформах. Препринт дослідження опубліковано на сайті arXiv.

Дослідники з Університету Нотр-Дам виявили, що боти зі штучним інтелектом (ШІ) можуть обходити захисні алгоритми популярних соціальних мереж. Стажери з освітою на рівні середньої школи і мінімальною підготовкою з використання ШІ запустили тестових ботів на різних майданчиках.

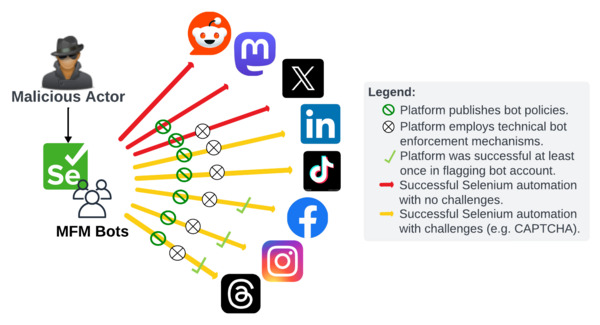

Дослідники спробували створити і запустити ботів на різних платформах – LinkedIn, Reddit, TikTok, X (колишній Twitter), Mastodon, а також Facebook, Instagram і Threads від Meta, щоб перевірити ефективність політик і механізмів захисту мереж від контенту, що автоматично генерується. Для створення ботів використовували Selenium – набір інструментів для автоматизації дій веб-браузерів, а також моделі GPT-4o і DALL-E 3 від OpenAI.

У серії експериментів дослідники опублікували нешкідливі “тестові” пости від імені ботів на всіх платформах. Найскладнішими для обходу виявилися системи захисту Meta, де знадобилося кілька спроб для запуску бота. Труднощі також виникли з TikTok – через часте використання CAPTCHA. Однак на Reddit, Mastodon і X запустити ботів виявилося зовсім просто, незважаючи на заявлені політики безпеки.

Ілюстрація результатів дослідження: червоним відмічено мережі, в яких не було жодних проблем, зеленим – мережі, які використовували захист для автопостів, але їх вдалося обійти. Галочка показує платформи, які хоча б раз успішно ідентифікували ботів. Зображення: University of Notre Dame

Дослідження демонструє проблему безпеки в соціальних мережах, заявляють учені. Хоча деякі боти використовуються в законних цілях, наприклад для маркетингу або обслуговування клієнтів, інші можуть застосовуватися для маніпулювання громадською думкою, поширення дезінформації або шахрайства.

Нездатність платформ ефективно виявляти і блокувати потенційно шкідливих ботів ставить під загрозу безпеку користувачів. Дослідники закликають до введення більш суворого законодавства, що вимагає від платформ чітко ідентифікувати акаунти людей і ботів, а також до розробки рішень для захисту від зловмисного використання ШІ в соціальних мережах.