Дослідники з Прінстонського університету розробили інструмент, який виявляє потенційні упередження в наборах зображень, використовуваних для навчання систем штучного інтелекту. Робота є частиною більш масштабного проєкту по виправленню та запобіганню упереджень, які проникли в системи ШІ, та впливають на все – від кредитних послуг до програм винесення вироків в залі суду.

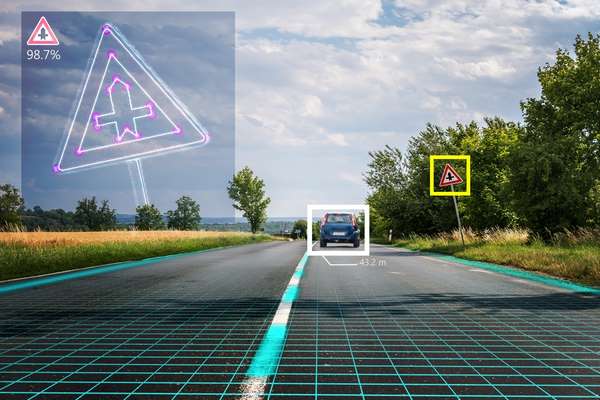

Хоча джерела упередженості в системах ШІ різноманітні, однією з її основних причин є стереотипні зображення, що містяться у великих наборах даних, зібраних з онлайн-джерел, які інженери використовують для розвитку комп’ютерного зору. Це гілка ШІ, яка дозволяє комп’ютерам розпізнавати людей, об’єкти і дії. Оскільки фундамент комп’ютерного зору будується на цих наборах даних, зображення, що відображають соціальні стереотипи та упередження, можуть ненавмисно впливати на моделі комп’ютерного зору.

Щоб допомогти усунути цю проблему в її першоджерелі, дослідники з Princeton Visual AI Lab розробили інструмент з відкритим вихідним кодом, який автоматично виявляє потенційні спотворення в наборах візуальних даних. Інструмент дозволяє творцям наборів даних і користувачам виправляти проблеми непредставлених або стереотипного зображення до того, як колекції зображень будуть використовуватися для навчання моделей комп’ютерного зору. У відповідній роботі члени Visual AI Lab опублікували порівняння існуючих методів запобігання упередженості в самих моделях комп’ютерного зору і запропонували новий, більш ефективний підхід до зниження упередженості.

Перший інструмент, званий REVISE, використовує статистичні методи для перевірки набору даних на предмет потенційних упереджень або проблем непредставлених за трьома вимірами: об’єктному, гендерному та географічному.

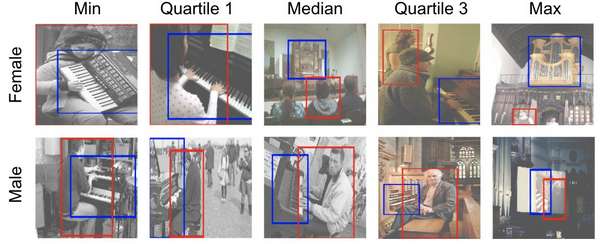

REVISE оцінює вміст набору даних, використовуючи існуючі анотації до зображень і такі вимірювання, як кількість об’єктів, спільна присутність об’єктів і людей, а також країни походження зображень. Серед цих вимірів інструмент виявляє закономірності, які відрізняються від медіанного розподілу.

Наприклад, в одному з протестованих наборів даних REVISE показав, що зображення, яке включає людей і квіти, розрізнялися у чоловіків і жінок: чоловіки частіше з’являлися з квітами на церемоніях або зустрічах, а жінки, як правило, з’являлися в постановочних декораціях або картинах.

Як тільки інструмент виявляє такого роду невідповідності, «виникає питання, чи є це абсолютно нешкідливим фактом або відбувається щось важливіше, і це дуже важко автоматизувати», – пояснює Ольга Русаковська, доцент кафедри інформатики і головний дослідник Visual AI Lab.

«Практика збору наборів даних в комп’ютерних науках до недавнього часу не вивчалась так ретельно», – робить висновок співавтор дослідження Анджеліна Ван, аспірантка в області комп’ютерних наук. Вона пояснює, що зображення в основному «беруться з Інтернету, і люди не завжди розуміють, що їх зображення використовуються [в наборах даних]. Ми повинні збирати зображення від більш різних груп людей і робимо це з повагою ».

Натхнення: hightech.fm